國產高速調制器芯片在寧產業化,這將實現國產高速光芯片的新突破!

“我們的芯片,馬上就能規模量產了,這將實現國產高速光芯片的新突破!”7月20日,江蘇鈮奧光電科技有限公司總經理蔡文杰分享了這一好消息。該項目快速產業化的背后,源于南京市級科創基金的一筆1000萬元天使投資。

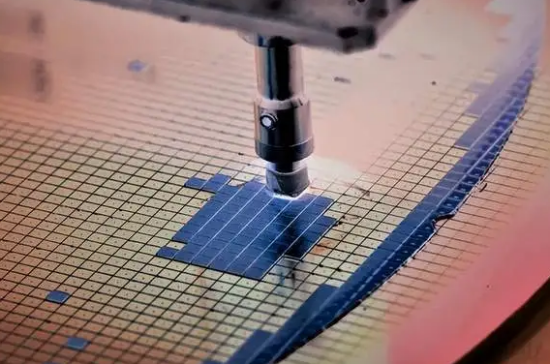

高速調制器光芯片可將電信號轉化為高速光信號,是光通信系統中不可或缺的一環。而光芯片是光電子器件的核心組成部分,應用場景包括電信、數據中心、工業、消費電子、汽車等領域。當前,我國高速光芯片的國產化率非常低。

3年前的夏天,鈮奧光電落地南京,致力于在國產高速光芯片領域取得突破。3年時間,該公司從初創時的9人發展到如今的近百人,核心團隊已掌握了全球領先的薄膜鈮酸鋰光芯片技術,并將在年內建成國內首條規模量產的薄膜鈮酸鋰光電子芯片產線,實現國內高速率光芯片新突破。

“產業化離不開先進裝備。”蔡文杰告訴記者,先進設備一臺就是幾百萬元甚至幾千萬元,公司成立至今已進行多輪融資,募集的資金主要用來購買先進設備,構建芯片及器件產線。2021年4月,南京市級科創基金的一筆1000萬元天使投資,投得早、來得及時,并承諾創始團隊可以在3年期滿后原值回購,相當于無息貸款,在企業初創期幫了不少忙。今年上半年,鈮奧光電又完成數億元A輪融資,市人才基金繼續追加投資,這筆資金將直接助力公司加速薄膜鈮酸鋰光電子芯片產線的建設和量產進程。

市科技局科技金融處相關負責人表示,2018年,南京設立市級科創基金,按照“政府引導、市場運作、合規管理、績效評價”的原則運作,并和社會資本成立多支子基金,做科技創新企業的“天使投資人”。截至目前,母基金直接投資項目已超百個,投資金額超6億元。

“服務高水平科技自立自強,下一步,我們將積極探索創新方式方法,引導更多金融活水流向科技企業,讓‘千里馬’輕裝上陣。”據介紹,今年6月,我市發布產業強市行動計劃,明確要壯大“2+6+6”創新型產業集群。同月,高質量建設科創金融改革試驗區推進大會召開,推出了一批針對性強、創新力度大的政策措施。7月18日,我市啟動“科技金融雙周匯”活動,將統籌舉辦債權融資、股權融資、上市培育等各類科技金融活動,為科技企業融資發展搭建平臺。市科技局將通過“價值發現”“陪伴成長”“助力騰飛”三大行動,陪伴科技企業在初創期、成長期、成熟期等各個時期對接金融資源,全力提升科技金融服務水平。

哦! 它是空的。

哦! 它是空的。